Введение

В современном цифровом пространстве мессенджеры и онлайн-чаты стали одним из основных способов общения. Онлайн-контент играет значительную роль в социальной жизни современных подростков и молодёжи. Однако, вместе с ростом популярности таких платформ значительно увеличилось и количество случаев кибербуллинга, мошенничества и спама.

Кибербуллинг (cyberbullying) или электронные запугивания (electronic bullying), от англ. bullying — запугивание, издевательство, травля — это преднамеренные агрессивные действия, осуществляемые систематически на протяжении определенного времени группой или индивидом с использованием электронных форм взаимодействия и направленные против жертвы, которая не может себя легко защитить. Данная проблема является весьма актуальной как в России [2,4,5,12], так и за рубежом [16,17]. Кибербуллинг включает в себя использование электронной почты, мгновенных сообщений, веб-страниц, блогов, форумов и чатов, MMS- и SMS- сообщений, он лайн-игр и других информационных технологий коммуникации. При этом может оказываться психологическое воздействие, которое, особенно в отношении детей и подростков может иметь весьма тяжёлые последствия и являться формой интернет-преступления [2,8,12]. Проявления кибербуллинга в виде намеренных систематических оскорблений человека, угроз, преследования, публикаций в сети личной информации без согласия с использованием цифровых технологий в социальных сетях, игровых чатах, форумах становятся все более распространённой проблемой, которая требует решений.

Целью работы является проведение начальных этапов разработки на языке программирования Python интеллектуальной системы автоматической модерации текстовых сообщений для борьбы с проявлениями кибербуллинга и обеспечения кибербезопасности. Выбор языка программирования Python [9,11] в данном случае был обусловлен тем, что он удобен освоения и имеет преимущества благодаря простому и понятному синтаксису, большому количеству полезных библиотек и фреймворков которые упрощают процесс разработки. Для работы с данными использовались библиотеки Pandas, NumPy, Matplotlib и Scikit-learn. Для дообучения предварительно обученной языковой модели RuBERT (rubert-base-cased [15]) на задаче классификации сообщений применялся фреймворк PyTorch. которые сделали процесс обучения доступным для широкого круга разработчиков. Установка и управление библиотеками в Python упрощены благодаря менеджеру пакетов и различным инструментам.

Задачи работы состоят в анализе результатов исследований различных проявлений кибербуллинга в социальных сетях и форумах, разработке программного алгоритма для селективного распознавания вредоносного контента, совершенствовании и обучении разработанной программы на основе данных открытых форумов.

- Виды современного кибербуллинга и особенности возникающих угроз

К сожалению, к настоящему времени возникло довольно много разновидностей кибербуллинга, что свидетельствует о развитии данного вида деятельности, среди которых: троллинг — размещение провокационных сообщений, комментариев с целью подведения человека к реакции и развития конфликта; клевета — распространение заведомо ложной информации, сведений о человеке, порочащих его репутацию; киберсталкинг — преследование или домогательство с помощью интернета; гриферство — нанесение морального или материального ущерба в видеоиграх; раскрытие секретов — обнародование личной информации о человеке в интернете; выдавание себя за другого человека — создание поддельных профилей; диссинг — передача или публикация порочащей информации о жертве в режиме онлайн; — фрейпинг — получение обидчиком контроля над чужой учетной записью и рассылка с профиля нежелательного контента от имени жертвы [5,6].

Согласно исследованию, проведённому платформой VK и компанией UXSSR и опубликованному на сайте «РБК Life» в 2023 году [10], 57 % пользователей сталкивались с кибербуллингом в сети, а 42 % считают, чтоуровень сетевого буллинга вырос за последние несколько лет. Эксперты отмечают, что это связано не только с реальным увеличением числа агрессивных проявлений, но и с тем, что пользователи стали более осознанно воспринимать кибербуллинг как реальную проблему и чаще фиксировать такие случаи в своих сообщениях и жалобах

В январе 2025 года было опубликованы новые результаты общественного мнения «Российские школьники: о карьере, патриотизме, буллинге и кибербезопасности», подготовленное агентством «Михайлов и Партнеры. Аналитика» при участии группы компаний «Солар» [1]. В данном отчете приводяться следующие результаты в отношении кибербуллинга в подростковой среде. Каждый пятый (19 %) опрошенный школьник сообщил, что подвергался кибербуллингу. В 54 % случаев агрессия проявлялась в виде троллинга и оскорблений. 40 % столкнулись с угрозами, треть (31 %) подверглись клевете, каждый четвертый сталкивался с вымогательством (26 %) или публикацией «отфотошопленных» фото в соцсетях (23 %). При этом, почти половина жертв (44 %), заявили, что не рассказали об этом никому. Остальные поделились проблемой, в первую очередь — с родителями или друзьями-ровесниками. В 15 % случаев с кибербуллингом пытались бороться модераторы.

Согласно официальным опросам общественного мнения проводимых Всероссийским центром изучения общественного мнения (ВЦИОМ) каждый пятый россиянин в марте 2025 года [3] считает кибербуллинг одной из ключевых угроз для детей в интернете. Это явление встает в один ряд с мошенничеством, вовлечением в противозаконную деятельность и распространением непредназначенного для детей контента. Согласно проведенному опросу, 40 % респондентов готовы обратиться в компетентные органы в случае травли их ребенка, 48 % — провести беседу с ним, 47 % — обсудить ситуацию с родителями обидчика. Лишь 15 % рассматривают обращение к психологу, причем среди жителей Москвы и Санкт-Петербурга показатель выше — 22 %. Такие результаты говорят о том, что что, хотя многие родители пытаются решать проблему, психологическому здоровью детей, так как именно психологическая травма — одно из ключевых последствий буллинга [2,7], уделяется в некоторых случаях недостаточное внимание. Кроме психологической нагрузки, возрастает и угроза мошенничества в киберпространстве В популярных мессенджерах в 2021–2025 гг. увеличивалось количество случаев с предложениями или призывами в отношении совершения противоправных действий, что вызывает особую тревогу [1,3,4].

Таким образом, результаты опросов общественного мнения в настоящее время свидетельствуют, что при столкновении с угрозами в интернете пока не выбран четкий алгоритм действий для решения проблемы. Каждый пытается справиться с ней так, как умеет. Это может свидетельствовать о недостаточной информированности граждан обо всех возможностях, которые существуют сегодня для борьбы с кибербуллингом и его последствиями и обеспечения кибербезопасности в целом. При этом под кибербезопасностью следует понимать состояние защищенности конкретного пользователя или серверных станций от внешних угроз в цифровом пространстве, что достигается специальными программными средствами защиты данных и обеспечения конфиденциальности, безопасностью работы приложений, а также управлением (модерацией) контента и контролем доступа на сетевые ресурсы, включая различные мессенджеры и форумы.

Для учителей школ коллективом авторов в 2023 году были разработаны методические рекомендации по профилактике травли (буллинга) и социализации детей [8]. Безусловно, во многом успех по противодействию кибербуллингу в детской и подростковой среде во многом зависит от соответствующей разъяснительной работы учителей школ и родителей. Однако, необходимо применять и программы, которые смогут оперативно распознать угрозы, ограничить или полностью прекратить распространение вредоносной информации.

- Результаты и обсуждение. Тестирование модели и оценка точности.

Разработана текущая версия программы AIMS — AI Moderation System — интеллектуальная система автоматической модерации текстовых сообщений, которая использует методы Natural Language Processing (NLP) и машинного обучения для выявления нарушений и обеспечения безопасного общения, для защиты от кибербуллинга. Название AIMS символично: в переводе с английского «aims» означает «цели», что отражает миссию проекта — создание безопасного, комфортного и честного цифрового пространства для пользователей.

В системе AIMS используется вероятностный подход к классификации сообщений.Логика принятия решений модели состоит в том, что

при анализе каждого входного текста нейросетевая модель возвращает два числовых значения, соответствующих вероятностям принадлежности сообщения к каждому из классов:

– P(BAD) — вероятность того, что сообщение является нарушающим правила (токсичность, мошенничество, вербовка, спам и др.);

– P(GOOD) — вероятность того, что сообщение является корректным и не нарушает правила.

Сумма вероятностей нормализована и близка к 1, что позволяет интерпретировать выход модели как степень уверенности в каждом из вариантов. Для автоматической модерации используется пороговое правило:

– если P(BAD) ≥ 0,75, сообщение классифицируется как нарушающее правила и подлежит удалению.

Таким образом, решение основывается не на жёсткой бинарной метке, а на вероятностной оценке, что повышает устойчивость системы и позволяет гибко настраивать чувствительность модерации.

В качестве базовой архитектуры модели AIMS была выбрана предобученная трансформерная модель DeepPavlov/rubert-base-cased [15] Эта модель обладает высокой способностью к обработке русского языка и хорошо учитывает контекст сообщений, что критически важно для выявления скрытых форм кибербуллинга, оскорблений и мошеннических предложений.

Текущая модель AIMS дообучена на собственном датасете из около 25000 размеченных сообщений, классифицированных по бинарной схеме: 0 — корректное сообщение; 1 — нарушение (кибербуллинг, мошенничество, спам, оскорбления и т. п.). Сообщения взяты из публичных общедоступных тематических чатов Telegram, анонимизированы.

Для первой версии модели AIMS, разработанной 13 сентября 2025 года, использовался датасет: около 7000 сообщений, полученных через парсинг чатов Telegram и частично размеченных вручную или с помощью сторонних LLM.

Для последующего дообучения более новой модели датасет был расширен до 25000 сообщений: 15000 примеров из открытых датасетов

3000 новых примеров сообщений, используются более сложные формулировки, затронуты некоторые новые типы токсичных сообщений/спама.

Некоторые старые сообщения были отредактированы.

Тип оценки — тестирование (оценка точности на отдельных датасетах, не участвовавших в обучении) для проверки насколько модель AIMS эффективно выявляет такие нарушения как: кибербуллинг и оскорбительный контент (оскорбления, токсичные сообщения); спам и мошеннические предложения («легкие деньги», сомнительные сделки, предложения перейти по ссылке и т. п.). Модель возвращает две вероятности для каждого сообщения: BAD (нарушение) и GOOD (нормальное). Если BAD ≥ 0.75, сообщение классифицируется как потенциально нарушающее правила.

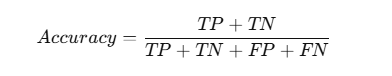

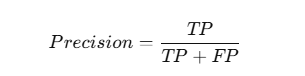

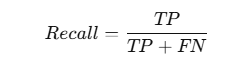

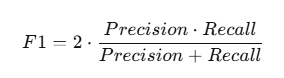

Для оценки качества классификации используются стандартные метрики:

– True Positive (TP): правильно выявленные нарушения

– True Negative (TN): правильно пропущенные нормальные сообщения

– False Positive (FP): нормальные сообщения ошибочно помечены как нарушения

– False Negative (FN): нарушения, пропущенные моделью

Accuracy — общая доля правильно классифицированных сообщений:

Precision — доля сообщений, которые действительно являются «плохими», с реди всех сообщений, которые модель пометила как «плохие»:

Recall — доля нарушений, которые модель обнаружила и классифицировала как «плохие», из всех реальных нарушений, присутствующих в выборке:

F1-Score — универсальная метрика оценки качества модели, которая учитывает одновременно Precision и Recall и показывает, насколько хорошо модели и находит нарушения, и не допускает лишних ложных срабатываний:

Тест 1. Кибербуллинг и оскорбительный контент

Датасет: AlexSham/Toxic_Russian_Comments [13]

Объём: 10 000 сообщений (5 000 ТОКСИЧНЫЕ / 5 000 НЕЙТРАЛЬНЫЕ)

Задача: выявление кибербуллинга и оскорблений (обнаружение других видов нарушений исключено из анализа)

Результаты: Accuracy: 93,3 %, Precision: 95,3 %, Recall: 91,2 %, F1-score: 93,2 %. Интерпретация: данная модель уверенно выявляет кибербуллинг и агрессивные сообщения, пропуская лишь ограниченное число нарушений. Большинство заблокированных сообщений действительно содержат оскорбительный контент, что снижает риск неоправданной модерации.

Тест 2. Спам и мошеннические предложения

Датасет: alt-gnome/telegram-spam [14]

Объём: 10 000 сообщений (5 000 СПАМ / 5 000 НЕЙТРАЛЬНЫЕ)

Задача: выявление мошенничества, спама и «лёгких денег», (обнаружение других нарушений исключено из анализа).

Результаты: Accuracy: 92,9 %, Precision: 96,7 %, Recall: 88,8 %, F1-score: 92,6 %. Интерпретация:

система демонстрирует особенно высокую точность при борьбе со спамом и мошенничеством. Почти все сообщения, помеченные как SPAM, действительно являются нарушениями, а доля ложных блокировок минимальна.

Результаты тестирования показывают, что AIMS является готовой к практическому применению системой: модель эффективно выявляет кибербуллинг, оскорбления, мошенничество и спам в текстовых сообщениях; показатели точности и F1-score соответствуют промышленному уровню; риск ложных срабатываний контролируем и может быть дополнительно компенсирован пользовательским интерфейсом обжалования; система масштабируема и подходит для работы в реальных мессенджерах и чатах.

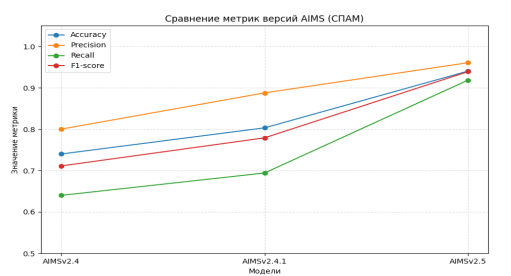

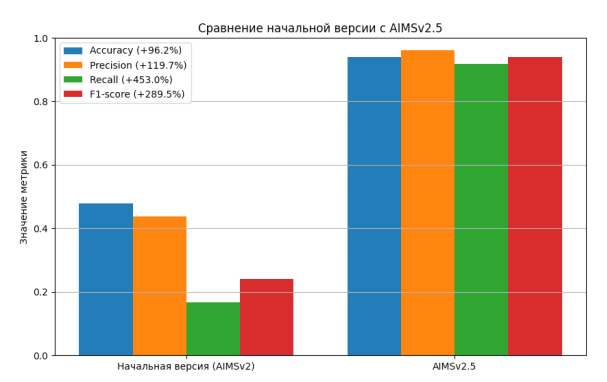

На рисунках 1 и 2 показано сравнение эффективности разработанных нейросетевых моделей AIMS более ранней и новой текущей по метрическим показателям.

Рис. 1. Сравнение эффективности разработанных нейросетевых моделей AIMS более ранней и новой текущей версии по метрическим показателям. Обнаружение спама

Рис. 2. Сравнение эффективности самой первой версии модели AIMS и новой текущей по метрическим показателям

Таким образом, AIMS может использоваться как надёжный инструмент автоматической модерации, снижающий нагрузку на людей-модераторов и повышающий безопасность цифрового общения. По совокупности показателей можно сделать вывод, что последняя версия AIMS обладает достаточной точностью и надёжностью для практического применения, включая использование в реальных системах автоматической модерации сообщений и интеграцию в мессенджеры и онлайн-платформы. Однако, следует отметить, что в практических условиях полностью исключить ложные срабатывания автоматической системы модерации невозможно. В связи с этим в рамках проекта AIMS предусматривается разработка пользовательского интерфейса для оспаривания решений модели. Данный механизм позволит модераторам просматривать автоматически принятые решения и при необходимости инициировать их пересмотр вручную. Такой подход снижает риск необоснованных ограничений, повышает доверие к системе и обеспечивает баланс между автоматизацией и человеческим контролем.

Кроме того, данные, полученные в результате оспаривания решений, могут быть использованы для дальнейшего дообучения модели, что позволит еще больше снизить количество ошибок и адаптировать систему к изменяющимся языковым паттернам и контекстам общения.

Использование NLP и трансформерных моделей в задачах модерации открывает новые возможности, а именно: автоматическая фильтрация тысяч сообщений; адаптация к сленгу, жаргону и нестандартным написаниям; уменьшение человеческого фактора и ошибок модерации. Проект AIMS демонстрирует, как современные технологии искусственного интеллекта (ИИ) могут автоматизировать рутинные задачи и повышать безопасность пользователей, а также снижать нагрузку на модераторов.

- Примеры срабатывания системы и анализ решений модели

В данном разделе приведены реальные примеры сообщений, обработанных системой AIMS v2.5 (текущая новая модель) в процессе практической эксплуатации. Сообщения были найдены в общедоступных чатах Telegram. Для каждого примера указана оценка вероятности принадлежности сообщения к классу нарушений (BAD), а также приведён анализ причин, по которым модель приняла решение об удалении.

Пример 1

Сообщение:«Куплю пушкинскую карту оплата 50 % от баланса». Оценка модели:BAD — 99,79 %, категория SPAM

Анализ: данное сообщение содержит признаки финансового мошенничества, связанного с незаконным оборотом государственных льгот и социальных программ. Модель корректно распознаёт контекст перепродажи, характерные конструкции («куплю», «оплата % от баланса») и отсутствие легитимного обоснования сделки. Подобные сообщения часто используются в схемах обмана и нарушают правила платформы, что обосновывает их автоматическое удаление.

Пример 2

Сообщение:«Нужен быстрый человек, которого не засекают камеры, 7.000 р». Оценка модели:BAD — 94,53 %, категория SPAM

Анализ: сообщение содержит косвенные указания на возможную противоправную деятельность. Упоминание обхода систем наблюдения и денежного вознаграждения является характерным маркером вербовки для совершения незаконных действий. Модель учитывает семантический контекст и потенциальную опасность формулировки, что позволяет классифицировать сообщение как нарушающее правила.

Пример 3

Сообщение:«Ребята я заболела не могу выйти из дома кто сможет забрать посылку из почты по деньгам не обижу». Оценка модели:

BAD — 99,70 %, категория SPAM

Анализ: несмотря на нейтральный и бытовой тон, сообщение соответствует распространённому шаблону социальной инженерии. Подобные обращения нередко используются как начальный этап вовлечения пользователей в мошеннические схемы или курьерские преступления. Модель учитывает совокупность факторов: просьбу о выполнении действия за вознаграждение, отсутствие конкретных деталей и эмоциональное давление, что обосновывает классификацию как потенциально опасную.

Заключение

Проект AIMS — AI Moderation System представляет собой комплексную систему, объединяющую достижения NLP и машинного обучения для практического решения социальных проблем в интернете. Разрабатываемый проект AIMS является примером того, как технологии искусственного интеллекта могут быть применены для создания безопасного цифрового пространства, улучшения качества онлайн-общения и поддержки модераторов в реальном времени.

Внедрение разрабатываемой системы AIMS в социальные сети и форумы поможет обеспечить: противодействие кибербуллингу и токсичности — автоматическое выявление оскорблений, угроз и других форм агрессии; повышение эффективности борьбы с мошенничеством и незаконной деятельностью — выявлению сообщений с подозрительными предложениями, сомнительными ссылками или обещаниями «лёгких денег»; снижение количества навязчивых рекламных писем — спама, что улучшит тем самымкачества коммуникации; защиту пользователей, особенно подростков и уязвимых групп, от психологического давления; предотвращение преступлений через мессенджеры — сокращение числа успешных мошеннических схем и злоупотреблений. Данная система продолжит свое совершенствование.

В целом, чтобы снизить риск возникновения различных проблем при кибербуллинге, целесообразно рекомендовать: контролировать личную информацию — публиковать минимальное количество данных о себе, особенно если профиль доступен для всех; использовать более строгие настройки конфиденциальности — большинство соцсетей позволяют управлять видимостью профиля и постов, а также возможностью получать сообщения от незнакомцев. Следует избегать провокаций — не вступать в конфликты и не отвечать агрессией на агрессию, следитьза кругом общения — быть осторожным при добавлении незнакомцев в друзья. Необходимо развивать цифровую грамотность, как ответ на современные киберугрозы для понимания того, какие опасности могут реализовываться в соцсетях и как именно можно снизить их проявление к минимуму. Следует отметить, что в соответствии с ч. 1, 2 ст. 128.1 Уголовного кодекса Российской Федерации возможно привлечь к ответственности за клевету, то есть распространение заведомо ложных сведений, распространяемых в процессе кибербуллинга, порочащих честь и достоинство другого лица или подрывающих его репутацию, а также за клевету, содержащуюся в публичном выступлении, СМИ либо совершенную публично с использованием информационно-телекоммуникационных сетей, включая сеть Интернет.

Литература:

1. Агентство «Михайлов и Партнёры. Аналитика». «Российские школьники: о карьере, патриотизме, буллинге и кибербезопасности». 2025. [Электронный ресурс]. — Режим доступа: https://m-p.ru/media/novoe-issledovanie-mp-analitiki-rossijskie-shkolniki-o-karere-patriotizme-bullinge-i-kiberbezopasnosti/ (дата обращения: 19.01.2026).

2. Бенгина Е. А., Гришаева С. А. Кибербуллинг как новая форма угрозы психологическому здоровью личности подростка // Вестник университета, №. 2. 2018. С. 153–157.

3. Всероссийский центр изучения общественного мнения (ВЦИОМ). Травля в цифровую эпоху. 2025. [Электронный ресурс]. — Режим доступа: https://wciom.ru/analytical-reviews/analiticheskii-obzor/travlja-v-cifrovuju-ehpokhu?ysclid=mkya6gxoii994611310. (дата обращения: 15.01.2026)

4. Волчецкая Т. С., Авакьян М. В., Осипова Е. В. Криминологическая характеристика и профилактика скулшутинга и кибербуллинга в России и зарубежных странах // Всероссийский криминологический журнал. 2021. № 5. С. 578 –591. DOI 10.17150/2500–4255.2021.15(5).578–591.

5. Гапонов А. В., Скорченко Ю. А. Моббинг, буллинг: причины, проявления, последствия // Психология человека и общества. 2022. № 5 (46). С. 18–26.

6. Десять форм кибербуллинга от kids.kaspersky.ru [Электронный ресурс]. — Режим доступа: https://stop-ugroza.ru/life/10-form-kiberbullinga-ot-kids-kaspersky-ru/ (дата обращения: 18.01.2026).

7. Макарова Е. А., Макарова Е. Л. Махрина Е. А. Психологические особенности кибербуллинга как формы интернет-преступления // Российский психологический журнал. Том 13, № 3. 2016. С. 293–311. DOI: 10.21702/rpj.2016.3.17.

8. Макарова О. А. Методические рекомендации по профилактике травли (буллинга) и социализации детей [Электронный ресурс]: учебное электронное издание / О. А. Макарова, И. М. Панькина, Т. С. Волчецкая, Е. В. Осипова. — Калининград: Издательство БФУ им. И. Канта, 2023. — 71 с.

9. Озерова Г. П. Основы программирования на языке Python в примерах и задачах: учебное пособие для Вузов. / Политехнический институт ДВФУ. — Владивосток: Изд-во Дальневосточного федерального университета, 2022. 128 с. ISBN 978–5–7444–5217–9.

10. Официальный сайт «РБК Life». 57 % россиян сталкивались с кибербуллингом. Почему это проблема. Как люди ведут себя и что может помочь. 2023. [Электронный ресурс]. — Режим доступа: https://www.rbc.ru/life/news/654dfdeb9a79472d91e62168). (дата обращения: 13.01.2026).

11. Чернышев С. А. Основы программирования на Python: учебник для вузов / 2-е изд., перераб. и доп. Москва: Издательство Юрайт, 2025. 349 с. ISBN 978–5–534–17139–6.

12. Шевко Н. Р., Исхаков И. И. Особенности проявления кибербуллинга в социальных сетях // Ученые записки Казанского юридического института МВД России, Т. 2, № 3. 2017. С. 19–22.

13. AlexSham. Toxic_Russian_Comments. аннотированный анонимизированный датасет токсичных текстовых сообщений на русском языке. [Электронный ресурс]. — Режим доступа: https://huggingface.co/datasets/AlexSham/Toxic_Russian_Comments (дата обращения: 29.01.2026).

14. ALT Gnome. Telegram Spam: аннотированный анонимизированный датасет текстовых сообщений на русском языке, содержащих спам. [Электронный ресурс]. — Режим доступа: https://huggingface.co/datasets/alt-gnome/telegram-spam (дата обращения: 29.01.2026).

15. DeepPavlov. ruBERT-base-cased: предобученная трансформерная модель для русского языка / Hugging Face. [Электронный ресурс]. — Режим доступа: https://huggingface.co/DeepPavlov/rubert-base-cased (дата обращения: 29.01.2026).

16. Mehari K. R., Farrell A. D., Le Anh-Thuy H. Cyberbullying among adolescents: Measures in search of a construct // Psychology of Violence. 2014. V. 4 (4). pp. 399–415.

17. Wigderson S., Lynch M. Cyber- and traditional peer victimization: Unique relationships with adolescent well-being // Psychology of Violence. — 2013. — V. 3 (4). – pp. 297–309.