Анализ многомерных временных рядов (МВР) представляет собой фундаментальную задачу в различных областях науки и техники, включая экономику, финансы, метеорологию, медицину и промышленное управление. Сложность исследования обусловлена высокой размерностью данных, наличием скрытых нелинейных зависимостей и нестационарным характером процессов. Традиционные статистические методы часто демонстрируют ограниченную эффективность при работе с такой структурой информации, что стимулирует активное развитие подходов, основанных на глубоком обучении (ГО). Глубокое обучение, в частности, рекуррентные нейронные сети (РНС) и их модификации, обладает потенциалом для автоматического извлечения сложных, иерархических признаков из сырых временных данных.

В контексте МВР глубокое обучение позволяет строить сложные нелинейные модели, способные улавливать как краткосрочные, так и долгосрочные зависимости между компонентами ряда. Модели, основанные на архитектурах LSTM (Long Short-Term Memory) или GRU (Gated Recurrent Unit), эффективно решают проблему затухания или взрыва градиентов, характерную для классических РНС, что критически важно при обработке протяженных последовательностей. Однако, при работе с реальными МВР, где динамика процессов может адаптироваться со временем, статические модели ГО оказываются недостаточными.

Применение нейросетей в прогнозировании экономических процессов, как отмечают Жуков Г. А., Михайлусь В. Е. и Осадчая А. В., демонстрирует их способность к «идентификации скрытых закономерностей, которые не поддаются обнаружению традиционными методами эконометрики» [3, С. 18]. Особенную актуальность приобретают адаптивные алгоритмы ГО, которые способны динамически настраивать свои параметры и структуру в ответ на изменения статистических свойств входных данных. Подобная адаптивность необходима для поддержания точности модели при наличии концептуального дрейфа (concept drift) или изменений режима (regime shifts) в анализируемых процессах.

Научная новизна предлагаемого исследования заключается в разработке и верификации архитектурно-адаптивных алгоритмов глубокого обучения, предназначенных специально для обнаружения и количественной оценки скрытых нелинейных связей в нестационарных многомерных временных рядах. Основной вклад в науку состоит в интеграции механизмов динамической реконфигурации нейросетевых слоев с адаптивными оптимизаторами скорости обучения, а также в разработке методики весового анализа важности признаков (feature importance) на основе градиентов для интерпретации выявленных нелинейных взаимосвязей.

В отличие от существующих подходов, фокусирующихся в основном на непрерывном обучении (как, например, в работе Милосердова, где представлена «усовершенствованная система нейросетевого прогнозирования групп временных рядов с непрерывным обучением» [5, С. 20]), наше исследование предлагает многоуровневую адаптацию. Первый уровень включает адаптивное управление гиперпараметрами обучения, в частности, использование модифицированных алгоритмов, таких как ADAM или RMSPROP, анализ которых проведен Перетягиным Н. А., Хитрых М. С., Котяковой В. А. [7, С. 32]. Второй, ключевой уровень, состоит в алгоритмической настройке топологии сети, включая добавление или удаление нейронов/слоев, что позволяет модели минимизировать избыточность и увеличивать репрезентативную мощность при изменении сложности скрытых зависимостей.

Для реализации адаптивного подхода в рамках МВР предлагается использовать модифицированные автокодировщики (Autoencoders) или вариационные автокодировщики (VAE) с рекуррентными слоями (например, Recurrent VAE). Выбор архитектуры обоснован необходимостью сжатия данных до латентного пространства, где нелинейные зависимости могут быть представлены в более простой, декорированной форме.

В латентном пространстве, как предполагается, скрытые нелинейные связи между компонентами МВР (например, между ценами различных активов в финансовом МВР) могут быть идентифицированы как корреляции высокого порядка или взаимная информация.

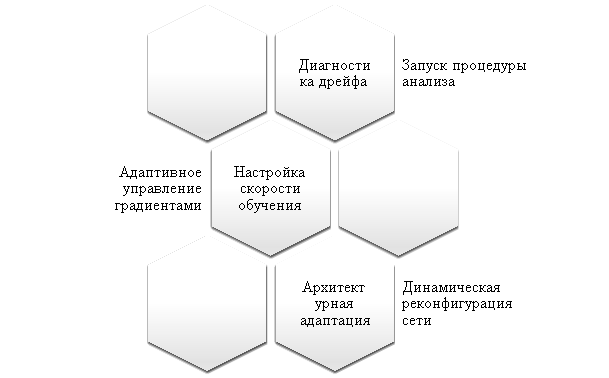

Ключевым элементом адаптации является механизм мониторинга производительности и стабильности обучения. В качестве критерия для активации адаптивного перестроения сети предлагается использовать скользящее окно ошибки прогнозирования и дивергенцию Кульбака-Лейблера (Kullback-Leibler divergence) между распределением латентных переменных на текущем и предыдущем временных интервалах. Значительное отклонение этих метрик сигнализирует о существенном изменении скрытого нелинейного процесса. Процесс адаптации включает шаги, представленные на рисунке 1.

Рис. 1. Составляющие процесса адаптации разработанных алгоритмов глубокого обучения для выявления нелинейных связей в многомерных временных рядах

1. Диагностика дрейфа: Запуск процедуры анализа.

Диагностика концептуального дрейфа (concept drift) представляет собой критически важный начальный этап, который определяет необходимость активации адаптационных механизмов. Концептуальный дрейф в контексте многомерных временных рядов (МВР) означает изменение скрытых нелинейных зависимостей или статистических свойств самих данных, что приводит к ухудшению предсказательной способности ранее обученной модели.

Для обнаружения концептуального дрейфа предлагается использовать двухкомпонентный механизм мониторинга:

— Мониторинг ошибки прогнозирования (E t ): отслеживается среднеквадратичная ошибка (MSE) или другая подходящая метрика на скользящем временном окне. Если E t устойчиво превышает заданный порог толерантности (τ Е ), или если наблюдается статистически значимый восходящий тренд в ошибке (например, с использованием контрольных карт Шухарта или CUSUM-алгоритмов), это служит первичным сигналом дрейфа. Увеличение ошибки указывает на то, что модель больше не может адекватно описывать новую динамику процесса.

— Мониторинг латентного пространства (z): поскольку нелинейные связи выявляются в латентном пространстве рекуррентного вариационного автокодировщика (RVAE), используется дивергенция Кульбака-Лейблера (D KL ). Измеряется D KL между текущим распределением латентных переменных p(z t ) на временном окне t и референсным распределением p(zr eƒ ), которое было оптимальным на момент последнего успешного обучения или адаптации. Значительное отклонение D KL от нуля (превышение порога τ KL ) свидетельствует о том, что скрытая структура данных изменилась, что является прямым доказательством изменения нелинейных связей.

При одновременном превышении τ Е и τ KL запускается процедура комплексного адаптивного анализа.

2. Настройка скорости обучения: Адаптивное управление градиентами.

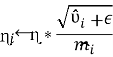

После диагностирования дрейфа первым шагом является реактивное управление оптимизатором. Для быстрого и точного реагирования на новые статистические свойства данных необходимо использовать адаптивные алгоритмы настройки скорости обучения, которые, как отмечается, «позволяют адаптировать скорость обучения для каждого параметра индивидуально». Среди таких оптимизаторов выделяют ADAM (Adaptive Moment Estimation), который использует экспоненциально-скользящие средние (ЭСС) первого и второго моментов градиента для расчета эффективной скорости обучения (ɳ i ) для каждого веса (ω i ):

где

Для усиления адаптивности в условиях дрейфа применяется модифицированный ADAM с периодическим сбросом ЭСС. Классический ADAM склонен к «памяти» о предыдущих больших градиентах, что может замедлить его реакцию на новые, сильно отличающиеся данные. Периодический сброс (например, обнуление

3. Архитектурная адаптация: Динамическая реконфигурация сети

Если простая настройка скорости обучения не восстанавливает точность модели в разумные сроки, активируется архитектурная адаптация — наиболее сложный и научно новый этап. Цель состоит в том, чтобы динамически изменить топологию латентного слоя RVAE, чтобы он мог эффективно кодировать новые, более сложные или, наоборот, упрощенные нелинейные связи. Подобная динамическая реконфигурация соответствует подходам, где модификация алгоритма используется для «распределения функций и задач» между компонентами системы [8, С. 208].

Процедура включает следующие подэтапы:

A. Анализ информативности нейронов (Прунинг)

Определяются наименее информативные нейроны в латентном слое, которые несут минимальный вклад в кодирование новых нелинейных связей. Для этого используется анализ градиентов или анализ весов:

— Анализ градиентов: вычисляется абсолютное значение среднего градиента

— Анализ весов: Нейроны, чьи исходящие веса близки к нулю (например, меньше порога τ W ), также могут быть удалены, поскольку они слабо влияют на декодирование.

При обнаружении избыточных нейронов производится прунинг (обрезка) — их удаление из архитектуры. Уменьшает сложность модели, предотвращает переобучение на новых данных и повышает вычислительную эффективность.

B. Динамическое добавление нейронов

Если диагностированный дрейф указывает на повышение сложности скрытых нелинейных связей (D KL сильно возрастает, а ошибка прогноза остается высокой), может потребоваться увеличение репрезентативной мощности латентного пространства. В этом случае происходит динамическое добавление новых нейронов к латентному слою.

— Инициализация весов: Новые нейроны должны быть инициализированы таким образом, чтобы минимизировать нарушение текущей стабильности обучения. Используются два подхода:

- Случайная инициализация: Веса инициализируются небольшими случайными значениями, что требует дополнительного обучения с низкой скоростью.

- Предварительно обученная инициализация (Knowledge Transfer): Веса могут быть инициализированы клонированием весов наиболее информативных существующих нейронов с добавлением небольшого шума, что позволяет быстро интегрировать новые элементы в уже функционирующую структуру.

Динамическая реконфигурация позволяет модели адаптироваться к меняющейся размерности и сложности скрытого нелинейного процесса в МВР, обеспечивая устойчивое выявление нелинейных зависимостей.

Выявление скрытых нелинейных связей неразрывно связано с интерпретируемостью модели. Предлагается использовать метод анализа важности признаков на основе градиентов (например, Integrated Gradients или DeepLIFT), примененный к декодеру рекуррентного автокодировщика. Величина и знак градиента выходной переменной (прогноза) по отношению к входным компонентам МВР в определенный момент времени служат мерой нелинейного влияния компонент друг на друга.

Например, в финансовом МВР, где компонентами являются цены акций, резкое изменение нелинейной связи между акциями разных секторов, выявленное моделью, может указывать на передаточные эффекты или инвариантные нули в многосвязных системах, аналогии которых встречаются в теории управления, как описывает Атамась Е. И. [1, С. 24]. Интерпретация таких связей позволяет принимать более обоснованные решения, например, при оптимизации инвестиционных портфелей, что соответствует прикладным задачам, описанным Пантелеевой А. И. [6, С. 1090].

Разработка адаптивных алгоритмов глубокого обучения для анализа МВР является актуальной задачей, решающей проблему нестационарности и скрытых нелинейностей в данных. Предложенная методология, основанная на архитектурной адаптации рекуррентных автокодировщиков и динамическом управлении обучением, позволяет создавать модели, способные гибко подстраиваться под меняющуюся структуру данных. Научная новизна заключается в комплексном подходе к адаптации и разработке методики интерпретации нелинейных связей через анализ градиентов.

Литература:

- Атамась Е. И. О связи инвариантных и передаточных нулей многосвязных систем // Научная конференция «Тихоновские чтения». — 2023. — С. 24.

- Вяльцев А. В. Эволюция педагогического дизайна в контексте развития адаптивных обучающих систем на базе машинного обучения // Управление образованием: теория и практика. — 2025. — Т. 15. — №. 4–1. — С. 50–62.

- Жуков Г. А., Михайлусь В. Е., Осадчая А. В. Применение нейросетей и машинного обучения в прогнозировании экономических процессов // Индустриальная экономика. — 2025. — №. 4. — С. 18–24.

- Кротов Е. Ю. Применение методов глубокого обучения для обнаружения фишинговых веб-сайтов: анализ эффективности и оптимизация моделей // Актуальные исследования. — 2025. — №. 21 (256). — С. 60–69.

- Милосердов Д. И. Усовершенствованная система нейросетевого прогнозирования групп временных рядов с непрерывным обучением // Информационно-управляющие системы. — 2024. — №. 1 (128). — С. 20–30.

- Пантелеева А. И. Применение алгоритмов глубокого обучения для оптимизации инвестиционных портфелей // Вестник науки. — 2025. — Т. 2. — № 1 (82). — С. 1090–1095.

- Перетягин Н. А., Хитрых М. С., Котякова В. А. Анализ алгоритмов адаптивной настройки скорости обучения (ADAM, RMSPROP, ADAGRAD) // Мир студенческой науки: сборник статей IX Международного научно-исследовательского конкурса. — Пенза: МЦНС «Наука и просвещение». — 2025. — С. 32–34.

- Шереужев М. А., Го У., Серебренный В. В. Модификация алгоритма глубокого обучения для распределения функций и задач между робототехническим комплексом и человеком в условиях неопределенности и переменности окружающей среды // Известия Кабардино-Балкарского научного центра РАН. — 2024. — Т. 26. — №. 6. — С. 208–218.